Combien d’entreprises découvrent, au moment d’une cyberattaque ou d’une panne matérielle, que leurs sauvegardes programmées depuis des mois ne fonctionnent plus ? Cette situation n’a rien d’exceptionnel. Le bilan chiffré 2025 publié par l’ANSSI met en évidence 1 366 incidents confirmés dont 128 compromissions par rançongiciel portées à sa connaissance, révélant une pression croissante sur les systèmes d’information français. Face à ces menaces, une sauvegarde fiable repose sur trois piliers structurants : la supervision quotidienne automatisée qui détecte les anomalies invisibles, les tests de restauration réguliers qui valident la récupérabilité réelle des données, et la redondance géographique sécurisée qui protège contre les sinistres localisés. Sans ces trois garanties opérationnelles, une sauvegarde programmée reste une simple promesse technique jamais vérifiée.

Vos 3 priorités pour garantir la fiabilité de vos sauvegardes :

- Activer un monitoring quotidien avec alertes automatiques pour détecter les erreurs silencieuses avant qu’elles ne se généralisent

- Planifier des tests de restauration trimestriels sur environnement isolé pour valider l’intégrité réelle de vos fichiers sauvegardés

- Appliquer la règle 3-2-1 avec redondance géographique dans un second datacenter pour résister aux sinistres localisés

Les 3 piliers d’une sauvegarde véritablement opérationnelle

Derrière chaque incident de perte de données se cache souvent la même illusion : croire qu’une sauvegarde programmée équivaut à une sauvegarde fonctionnelle. Les chiffres révèlent pourtant une autre réalité. Sur les 128 attaques par rançongiciel recensées en 2025 par l’ANSSI, une proportion significative d’organisations n’a pu récupérer ses données malgré l’existence théorique de sauvegardes, simplement parce que ces copies n’avaient jamais été testées ou que les erreurs de sauvegarde s’accumulaient silencieusement depuis des mois.

Une stratégie de sauvegarde fiable s’articule autour de trois exigences techniques interdépendantes. La première consiste à surveiller en continu le bon déroulement des opérations de sauvegarde grâce à un système de monitoring actif. La deuxième impose de valider régulièrement la capacité réelle à restaurer les données en conditions réelles. La troisième garantit la disponibilité des copies même en cas de destruction du site principal. Ces trois dimensions forment un tout indissociable : retirer l’une d’elles fragilise immédiatement l’ensemble du dispositif.

Le récapitulatif ci-dessous compare ces trois piliers selon leur fréquence d’intervention, leur impact en cas d’absence et leur complexité de mise en œuvre. Chaque critère pèse différemment selon la maturité technique de l’organisation et le niveau de criticité des données protégées.

| Pilier | Fréquence minimale | Impact si absent | Complexité mise en œuvre |

|---|---|---|---|

| Supervision quotidienne | Quotidienne (24/7) | Erreurs silencieuses non détectées | Moyenne (outil monitoring requis) |

| Test restauration | Trimestrielle minimum | Corruption données découverte tardivement | Faible (procédure manuelle possible) |

| Redondance géographique | Continue (réplication temps réel) | Perte totale si sinistre site principal | Élevée (infrastructure double nécessaire) |

Le monitoring actif d’une infrastructure de sauvegarde ne se limite pas à vérifier qu’un processus automatique s’est bien exécuté. Il consiste à analyser en temps réel les logs générés, à détecter les anomalies de volumétrie (fichiers manquants, taille incohérente), à identifier les erreurs de lecture ou d’écriture sur les supports de stockage, et à déclencher des alertes immédiates en cas de défaillance. Cette surveillance proactive permet de corriger les problèmes avant qu’ils ne se généralisent à l’ensemble du parc sauvegardé.

Les erreurs silencieuses constituent le principal danger d’une sauvegarde passive. Un fichier verrouillé par une application, un répertoire temporairement inaccessible ou une saturation progressive de l’espace disque peuvent bloquer la sauvegarde de données critiques sans que le système n’émette le moindre avertissement visible. Seul un outil de supervision capable de comparer les métriques attendues (nombre de fichiers, volumétrie totale) avec les résultats effectifs peut détecter ces déviations avant qu’il ne soit trop tard.

Tester une sauvegarde signifie restaurer effectivement un échantillon représentatif de données sur un environnement isolé et vérifier manuellement l’intégrité des fichiers récupérés. Cette opération valide non seulement la lisibilité technique des supports de sauvegarde, mais aussi la cohérence fonctionnelle des données restaurées : un fichier qui s’ouvre sans erreur mais dont le contenu est partiellement corrompu ne présente aucune utilité en cas de sinistre réel.

La fréquence minimale recommandée pour ces tests s’établit à un cycle trimestriel pour les données critiques. Les organisations à haute criticité (santé, finance, services essentiels) doivent envisager une cadence mensuelle. L’objectif n’est pas de restaurer l’intégralité du parc à chaque itération, mais de valider un périmètre tournant couvrant progressivement l’ensemble des données sauvegardées sur une année complète.

La règle 3-2-1 formalisée par l’ANSSI constitue le socle minimal d’une stratégie de sauvegarde robuste. Conformément aux recommandations techniques de l’ANSSI (guide ANSSI-BP-100), cette règle impose de conserver trois copies distinctes des données, stockées sur deux supports différents (disque local, bande magnétique, stockage cloud), dont une copie externalisée hors du site principal. Cette architecture garantit la survie des données même en cas de sinistre majeur (incendie, inondation, vol) affectant le site principal.

La réplication géographique dans un second datacenter distant renforce ce dispositif en assurant la haute disponibilité. Plutôt que de simplement stocker une copie passive sur un support externe, cette approche réplique en temps réel les données sauvegardées vers une infrastructure redondée située dans une zone géographique distincte. La diversification des supports et localisations renforce la résilience par solutions de sauvegarde face aux scénarios de défaillance multiples.

La durée de rétention minimale généralement observée s’établit autour de 12 mois pour permettre la récupération de données anciennes et respecter les contraintes réglementaires sectorielles variables.

Supervision active : le garde-fou contre les défaillances invisibles

Imaginons une PME qui programme chaque nuit une sauvegarde complète de ses serveurs. Tous les matins, le voyant lumineux du périphérique de stockage affiche un statut vert rassurant. Pourtant, depuis trois semaines, un défaut de connexion réseau empêche la sauvegarde d’une base de données critique de 2 Go sans que le système n’envoie la moindre alerte. Ce type de défaillance invisible représente l’un des risques les plus fréquents observés lors des audits de sécurité : une sauvegarde programmée n’est pas une sauvegarde surveillée.

Risque majeur : les erreurs silencieuses de sauvegarde

Une sauvegarde programmée qui s’exécute sans alerter d’erreur ne garantit pas que vos données sont récupérables. Les erreurs silencieuses (corruption progressive, fichiers verrouillés non sauvegardés, saturation espace disque) passent inaperçues sans supervision active. Le monitoring quotidien détecte ces anomalies avant qu’il ne soit trop tard.

Cette vigilance proactive repose sur des mécanismes d’analyse automatisée des métriques de sauvegarde. Chaque opération génère un ensemble d’indicateurs (nombre de fichiers traités, volumétrie totale, durée d’exécution, erreurs rencontrées) que le système de monitoring compare avec les valeurs de référence attendues. Toute dérive significative déclenche immédiatement une alerte transmise par email, SMS ou via une interface de gestion centralisée.

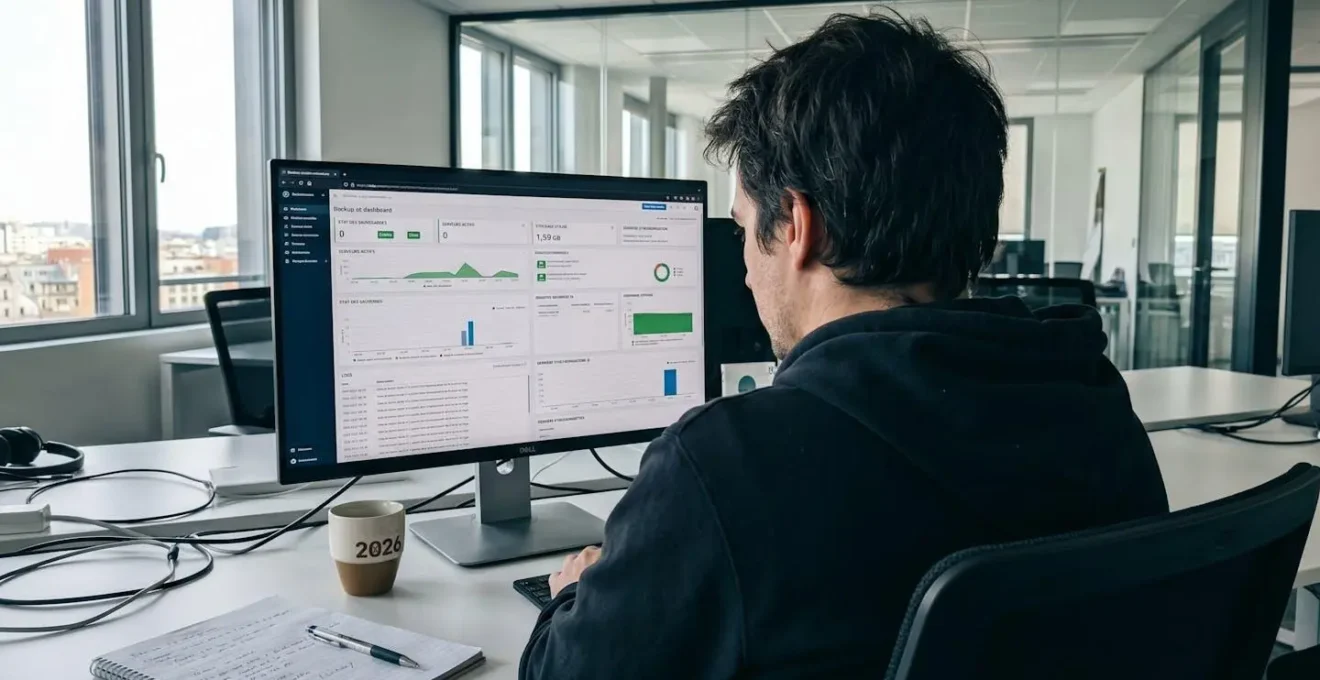

Les organisations gérant des volumes critiques de données bénéficient également de tableaux de bord synthétiques permettant de visualiser en temps réel l’état global de leur infrastructure de sauvegarde. Ces interfaces affichent l’historique des opérations réussies, les tendances d’évolution de la volumétrie sauvegardée, et les éventuelles anomalies détectées sur les 30 derniers jours. Cette traçabilité complète facilite les audits de conformité RGPD et la justification des mesures de sécurité mises en œuvre.

La distinction entre sauvegarde passive et supervision proactive réside dans la capacité à anticiper les défaillances plutôt qu’à les subir. Un système de monitoring actif analyse en continu les rapports d’exécution, compare les volumétries sauvegardées avec les références attendues, vérifie la cohérence des métadonnées et déclenche des alertes automatiques dès qu’une dérive est détectée. Cette approche transforme la sauvegarde d’une tâche technique automatisée en un processus contrôlé et auditable.

Les organisations qui délèguent leur sauvegarde à une entreprise de sauvegarde informatique spécialisée bénéficient d’un monitoring quotidien automatisé avec alertes en temps réel et rapports réguliers de supervision. Cette externalisation permet de s’affranchir de la complexité technique du monitoring tout en garantissant une surveillance 24/7 déléguée à des équipes dédiées. Les solutions supervisées incluent généralement la détection des erreurs silencieuses, l’analyse des logs de sauvegarde et la traçabilité complète des opérations effectuées.

Ce que le monitoring quotidien vérifie réellement : Le monitoring quotidien inclut la vérification automatique de l’intégrité des fichiers sauvegardés, la comparaison des volumétries attendues avec les résultats effectifs, et la détection des fichiers verrouillés ou inaccessibles lors de la fenêtre de sauvegarde. Ces contrôles permettent d’identifier rapidement les anomalies avant qu’elles ne compromettent l’ensemble du dispositif de protection.

Test de restauration : la seule garantie que vos données sont récupérables

Prenons le cas concret d’un cabinet d’architectes de 15 collaborateurs basé en région lyonnaise. L’entreprise sauvegardait quotidiennement 9 To de données (plans AutoCAD, maquettes 3D, bases de données projets) sur un NAS local couplé à un disque externe rotatif. Aucun test de restauration n’avait jamais été réalisé depuis la mise en place du système trois ans auparavant. Lors d’un audit de sécurité demandé par un client grand compte, la surprise fut brutale : 40% des fichiers restaurés présentaient une corruption partielle ou totale, les rendant inutilisables. Le cabinet découvrait que sa protection était fictive au moment précis où il devait en prouver l’efficacité.

Cas pratique : migration d’un cabinet d’architectes vers une sauvegarde supervisée

Dans une configuration classique où quinze collaborateurs accumulent progressivement 9 To de fichiers critiques (plans, maquettes 3D, bases projets), la situation peut rapidement devenir catastrophique. Ce cabinet découvrit lors d’un audit que 40% des fichiers restaurés étaient corrompus, rendant inutilisables des années de travail malgré l’existence théorique d’une sauvegarde locale quotidienne. La migration vers une solution externalisée supervisée a permis de corriger immédiatement cette faille : sauvegarde complète initiale (FirstSave) réalisée sur datacenter sécurisé, puis sauvegarde incrémentielle quotidienne automatisée avec cryptage AES 256 bits, monitoring actif délégué et tests de restauration trimestriels planifiés. Résultat concret : la confidentialité des fichiers chiffrés garantie en conformité RGPD grâce au stockage souverain en datacenters français, supervision quotidienne avec alertes automatiques, et rationalisation des coûts d’infrastructure locale.

Ce scénario illustre une réalité fréquemment observée : la majorité des organisations ne découvrent l’inefficacité de leurs sauvegardes qu’au moment critique où elles en ont réellement besoin. Tester une sauvegarde ne consiste pas simplement à vérifier qu’un fichier peut être copié depuis le support de stockage. Il s’agit de valider l’intégrité fonctionnelle complète : le fichier s’ouvre-t-il correctement dans son application native ? Les métadonnées (dates, auteurs, versions) sont-elles préservées ? Les liens entre fichiers interdépendants (bases de données, projets multi-fichiers) fonctionnent-ils après restauration ?

La méthodologie de test se structure autour de huit étapes de validation indispensables. Chaque trimestre, un périmètre représentatif de données doit être restauré sur un environnement isolé pour éviter tout risque d’écrasement de fichiers de production. Les résultats doivent être documentés systématiquement, et les anomalies détectées corrigées immédiatement avant le cycle de test suivant.

- Sélectionner un échantillon représentatif de fichiers critiques (10 à 15% de la volumétrie totale couvrant différents types de données)

- Restaurer les fichiers sur un environnement de test isolé (jamais directement en production pour éviter tout écrasement accidentel)

- Vérifier l’intégrité fonctionnelle des fichiers restaurés (ouverture dans application native, absence de corruption visible, métadonnées préservées)

- Mesurer le délai effectif de restauration et le comparer au RTO (Recovery Time Objective) théorique défini

- Tester la restauration d’une base de données complète si applicable (vérifier cohérence relationnelle et indexation fonctionnelle)

- Valider le bon fonctionnement des logs de sauvegarde (traçabilité complète des opérations, dates cohérentes, volumétries documentées)

- Vérifier la disponibilité et la lisibilité de la clé de cryptage si les sauvegardes sont chiffrées

- Documenter formellement les résultats du test et les éventuelles anomalies détectées pour traçabilité et amélioration continue

Les 5 idées reçues qui fragilisent votre stratégie de sauvegarde

Certaines croyances techniques persistent malgré leur dangerosité avérée. Déconstruire ces idées reçues permet d’éviter les fausses sécurités qui laissent les organisations vulnérables au moment critique. Les quatre mythes suivants concentrent l’essentiel des erreurs de conception observées lors des audits de sécurité menés en PME et ETI.

À quelle fréquence faut-il réellement tester ses sauvegardes ?

La fréquence minimale recommandée s’établit à un cycle trimestriel (tous les trois mois) pour les données critiques. Les entreprises à haute criticité (santé, finance, services essentiels) doivent envisager une cadence mensuelle. L’objectif consiste à détecter toute corruption ou défaillance avant qu’elle ne se généralise à l’ensemble du parc sauvegardé. Un test rigoureux valide non seulement la lisibilité technique des supports, mais aussi l’intégrité fonctionnelle des données restaurées.

Le RAID peut-il remplacer une sauvegarde externalisée ?

Non, le RAID protège uniquement contre la panne matérielle d’un disque au sein d’une grappe. Il ne protège ni contre la suppression accidentelle de fichiers, ni contre les attaques par rançongiciel qui chiffrent l’ensemble des données accessibles, ni contre l’incendie ou le vol du serveur physique. Le RAID et la sauvegarde externalisée sont complémentaires, jamais substituables. La première assure la continuité de service immédiate, la seconde garantit la récupérabilité à long terme.

La sauvegarde cloud est-elle automatiquement conforme au RGPD ?

Non, la conformité RGPD dépend de plusieurs facteurs indépendants du simple hébergement cloud : la localisation géographique des serveurs (stockage en Union Européenne fortement recommandé), le chiffrement bout-en-bout des données, la politique de rétention alignée sur les finalités de traitement, et les garanties contractuelles du prestataire. Ce que détaille le cadre CNIL sur le cycle de vie des données impose que la durée de conservation soit déterminée selon la finalité initiale de collecte. Vérifiez systématiquement que votre prestataire utilise des datacenters souverains français ou européens et respecte les clauses contractuelles types pour les transferts hors UE.

Quelle différence entre sauvegarde incrémentielle et différentielle ?

La sauvegarde incrémentielle copie uniquement les fichiers modifiés ou créés depuis la dernière sauvegarde (quel que soit son type : complète, incrémentielle ou différentielle). La sauvegarde différentielle copie tous les fichiers modifiés depuis la dernière sauvegarde complète uniquement. L’incrémentielle optimise la bande passante et le temps d’exécution quotidien, mais la restauration nécessite de reconstituer la chaîne complète (sauvegarde complète + tous les incréments successifs). La différentielle alourdit chaque cycle quotidien, mais simplifie la restauration (sauvegarde complète + dernière différentielle uniquement).

Combien de temps faut-il conserver les sauvegardes ?

La durée de rétention dépend directement de votre secteur d’activité et des obligations légales qui s’y appliquent. En règle générale, une rétention minimale de 12 mois est recommandée pour permettre la récupération de données anciennes et respecter les contraintes réglementaires sectorielles variables. Certains secteurs (santé, finance, secteur public) imposent des durées plus longues pouvant atteindre plusieurs années. La conformité RGPD exige que cette durée soit proportionnée à la finalité initiale de collecte des données personnelles sauvegardées.

Pour approfondir les bénéfices de l’externalisation et comprendre comment une architecture redondée protège contre les scénarios de défaillance multiples, consultez l’analyse détaillée sur l’importance de la sauvegarde cloud pour la continuité d’activité des organisations modernes.

Limites :

- Ce guide ne remplace pas un audit personnalisé de votre infrastructure informatique par un expert certifié

- Les délais et volumétries mentionnés sont des moyennes constatées en 2025-2026 et peuvent varier selon votre configuration spécifique

- Chaque entreprise nécessite une analyse spécifique de ses besoins de rétention et de redondance selon son secteur d’activité

Risques explicites :

- Risque de non-conformité RGPD si les données sont hébergées hors Union Européenne sans garanties adéquates (clauses contractuelles types)

- Risque d’échec de restauration si les tests ne sont pas réalisés au minimum trimestriellement sur un périmètre représentatif

- Risque de perte de données si la supervision n’inclut pas d’alertes automatiques en cas d’erreur de sauvegarde

Organisme à consulter : Expert en cybersécurité certifié ISO 27001 ou prestataire d’infogérance qualifié pour une analyse personnalisée de votre infrastructure.